Если у вас есть всего несколько свободных минут, вот что вы должны знать.

-

OpenAI имеет четыре версии модели GPT-3: Ada, Babbage, Curie и Davinci. Ada является самой маленькой и самой дешевой в использовании моделью, но работает хуже всего, в то время как Davinci является самой большой, самой дорогой и лучшей в наборе.

-

GPT-3 Davinci является самой эффективной моделью на рынке сегодня. Он был обучен на большем количестве данных и с большим количеством параметров, чем его альтернативы с открытым исходным кодом, GPT-Neo и GPT-J.

-

GPT-J в целом работает лучше, чем меньшие версии моделей GPT-3 от OpenAI, Ada и Babbage, но не так хорошо, как Davinci.

-

GPT-Neo и GPT-J являются открытым исходным кодом и бесплатными в использовании, и оба являются хорошими альтернативами GPT-3 от OpenAI для пользователей, для которых стоимость является ограничением.

-

GPT имеет широкое применение в таких отраслях, как развлечения, реклама, информационные технологии, разработка программного обеспечения и многое другое. Наличие альтернатив GPT-3 с открытым исходным кодом делает эту технологию более доступной и доступной для пользователей, что является отрадным событием.

-

GPT-3 примечателен, но иногда терпит неудачу и ему предстоит пройти долгий путь, прежде чем он сможет справиться с такими задачами, как открытый чат.

Этот пост спонсируется Multimodal, магазином разработки в Нью-Йорке, который фокусируется на создании пользовательских решений для обработки естественного языка для команд разработчиков с использованием больших языковых моделей (LLMs).

С Multimodal вы сократите время выхода на рынок для внедрения НЛП в свой продукт. Проекты занимают всего 3 месяца от начала до конца и стоят менее 50% вновь сформированных команд НЛП, без каких-либо хлопот. Свяжитесь с ними, чтобы узнать больше.

«Робот написал всю эту статью. Ты еще не испугался, человек?»

Так называлась статья в Guardian, опубликованная в сентябре 2020 года. И, как следует из этого, автором был робот — модель обработки естественного языка, разработанная OpenAI. Этот «микроробот» известен как GPT-3. Выпущенный 11 июня 2020 года, GPT-3 стал самым обсуждаемым в мире генератором языков.

Хотя GPT-3 был одной из немногих моделей в своем роде, когда он дебютировал в 2020 году, сегодня существует несколько альтернатив, таких как GPT-Neo и GPT-J. Как эти альтернативы сравниваются с GPT-3? Они лучше или хуже или просто по-другому?

Давайте рассмотрим каждый из этих вопросов.

Аббревиатура GPT расшифровывается как генеративная предварительная подготовка. С 2018 года OpenAI использует этот метод глубокого обучения для обучения языковых моделей. Этот метод включает в себя обучение модели на больших объемах данных, чтобы улучшить ее способность предсказывать следующее наиболее вероятное слово в предложении.

Используя эту и мозгоподобную нейронную сеть под названием Transformer, OpenAI впервые выпустила GPT в 2018 году, а затем GPT-2 в 2019 году и GPT-3 в 2020 году. Каждый преемник был обучен на большем количестве данных и с большим количеством параметров и был лучше настроен, чем предыдущий.

GPT-3 был обучен с 175 миллиардами параметров - число в десять раз больше, чем его предшественник, GPT 2, был обучен. Текстовые поколения GPT-3 довольно ошеломляющие. Он может переводить с языка на другой, распознавать именованные сущности в тексте, обобщать статьи и составлять полнометражные части.

GPT-3 в настоящее время поставляется в четырех версиях. Ада — самая маленькая и дешевая, в то время как Давинчи — самая большая и самая дорогая. Ниже приведены подробности каждой модели вместе с ценами.

Пользователи могут вводить простые текстовые команды в GPT-3, и модель дает в основном последовательные результаты. GPT-3 также может быть довольно креативным, сочиняя все, от художественной литературы до поэзии в стиле Шекспира, Роберта Фроста, Бернса или любого другого известного поэта.

Такие возможности обходятся огромной ценой — буквально. GPT-3 не является открытым исходным кодом. Он доступен через API OpenAI, но API чрезвычайно дорог. Хотя высокие затраты ограничили массовое внедрение GPT-3, исследователи и профессионалы активно создают прототипы и коммерческие приложения, используя его сегодня.

За последние несколько лет несколько стартапов разработали собственные альтернативы GPT-3. Разработка такой системы, как GPT-3, требует огромных первоначальных инвестиций. Несмотря на такие препятствия, такие компании, как EleutherAI, разработали и выпустили языковые модели с открытым исходным кодом, чтобы конкурировать с GPT-3.

Многие из этих моделей не так мощны, как самые большие версии GPT-3 (такие как Curie и Davinci), но они работают так же хорошо, как и более простые модели GPT-3 (такие как Ada и Babbage).

Вот краткое изложение популярных альтернатив GPT-3 с открытым исходным кодом.

GPT-Neo является альтернативой GPT-3 с открытым исходным кодом и находится в открытом доступе. Модель была разработана EleutherAI, децентрализованной группой исследователей и ученых ИИ, основанной в 2020 году. Миссия EleutherAI состоит в том, чтобы сделать ИИ более доступным путем разработки и выпуска моделей с открытым исходным кодом.

Поскольку EleutherAI не имел доступа к такому обширному и разнообразному набору данных, как OpenAI, он получил свой собственный набор данных объемом 825 гигабайт под названием «The Pile». Этот набор данных включает в себя данные из академических источников, таких как Pubmed, общих веб-сайтов, таких как Wikipedia и Github, и даже субтитры из фильмов и телешоу. Поскольку у нее не было частных вычислительных ресурсов для разработки своих моделей, EleutherAI использовала ресурсы облачных вычислений из облака Google TensorFlow Research и облака CoreWeave.

EleutherAI также разработала и выпустила вторую, более крупную версию модели под названием GPT-J, которая имеет больше параметров и лучше справляется с задачами NLP, чем ее меньший, более ранний предшественник, GPT-Neo. GPT-J прошел обучение по 6 миллиардам параметров и может выполнять такие задачи, как написание историй, информационный поиск, перевод и генерация кода.

EleutherAI также разработал простой пользовательский интерфейс для GPT-J. Этот интерфейс позволяет пользователям повысить уровень креативности модели с помощью параметра, известного как «температура». Кроме того, интерфейс имеет встроенные подсказки для пользователей для демонстрации возможностей модели.

EleutherAI использовал TRANSFORMer на основе JAX (библиотека Python, часто используемая для проектов машинного обучения) для разработки GPT-J. Модель обучалась на том же наборе данных, что и GPT-Neo.

В то время как GPT-Neo и GPT-J являются наиболее известными альтернативами GPT-3 от OpenAI, другие компании разрабатывают свои собственные варианты GPT-3. Некоторые из этих вариантов могут обогнать GPT-Neo и GPT-J по популярности. Например, Cohere, канадская лаборатория искусственного интеллекта, начала выпускать серию языковых моделей. Другая компания под названием AI21 labs выпустила Jurassic-1, модель, обученную на 178 миллиардах параметров. Эта модель конкурирует по размеру с самой большой версией GPT-3 OpenAI, Davinci.

В то время как эти другие заслуживают мониторинга, GPT-J и GPT-Neo являются наиболее популярными альтернативами GPT-3 с открытым исходным кодом сегодня.

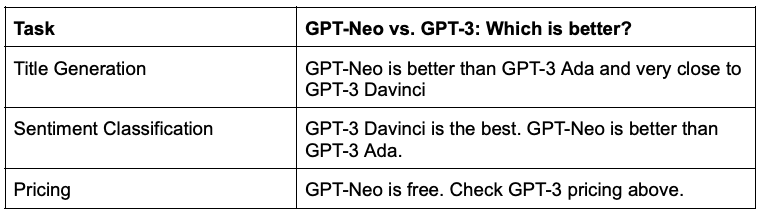

Georgian, финтех-компания, недавно сравнила производительность GPT-Neo с GPT-3. Вот ключевой вывод: GPT-Neo лучше, чем самая маленькая модель OpenAI, Ada, но не так хороша, как самая большая модель OpenAI, Давинчи. При этом GPT-Neo является бесплатным, в то время как GPT-3 Davinci очень дорогой.

GPT-Neo против GPT-3 в задаче создания заголовка

Грузинская команда попросила GPT-Neo и GPT-3 создать заголовки сообщений в блоге с учетом следующей подсказки: В сообщении описывается процесс создания вдумчивых заметок о встрече. Автор рассказывает о том, как он приучил себя запоминать происходящее во время долгих встреч, и предлагает действенные шаги для интеграции привычки делать заметки в свою жизнь.

Вот результаты.

GPT-Neo работает лучше, чем GPT-3 Ada, но не так хорошо, как GPT-3 Davinci. Например, GPT-Neo генерировал такие названия, как «Делая заметки во время встреч», в то время как GPT-3 Davinci генерировал заголовки, такие как «Как делать заметки с встреч, как босс».

GPT-Neo против GPT-3 по задаче

классификации настроений Результаты классификации настроений были аналогичными: GPT-Neo превзошел GPT-3 Ada, но не смог сравниться с производительностью GPT-3 Davinci. Ознакомьтесь с более подробными результатами здесь.

Сравнение

цен GPT-Neo является открытым исходным кодом и бесплатным. ГПТ-3 Давинчи, с другой стороны, дорогой. Для абсолютной лучшей производительности OpenAI по-прежнему выигрывает, но пользователи с ограниченными бюджетами или большими заданиями машинного обучения должны рассматривать GPT-Neo в качестве альтернативы.

Несколько разработчиков провели тесты между GPT-J и GPT-3. Эти тесты включали как задачи с нулевым выстрелом (задачи, в которых в модели не приводятся помеченные примеры), так и несколько задач выстрела. Вот основные выводы:

-

В настройках нулевого выстрела нет заметной разницы между производительностью GPT-J и GPT-3.

-

Аппаратная производительность GPT-J находится на одном уровне с GPT-3 Babbage.

-

GPT-J обрабатывает разговоры чат-ботов лучше, чем GPT-3.

-

GPT-J превосходит GPT-3 в генерации кода Python.

-

GPT-J является бесплатным, основным пунктом продажи.

GPT-J работает аналогично GPT-3 в настройках

Zero-Shot Когда дело доходит до задач с нулевым выстрелом, GPT-J выполнял очень близко к GPT-3. Аран Комацузаки, человек, который проводил тесты выше, также заметил, что GPT-J был гораздо более эффективен в аппаратной производительности, чем GPT-Neo. GPT-J имел аппаратную производительность, аналогичную GPT-3 Babbage.

GPT-J имеет лучшие возможности чат-бота, чем GPT-3

По словам Макса Вулфа, GPT-J лучше генерирует код, чем GPT-3. Отметим, что эти испытания были с середины 2021 года, а GPT-3 Davinci тогда был недоступен. GPT-3 Davinci теперь может соперничать или превосходить по производительности GPT-J.

GPT-J лучше в генерации

кода на Python Woolf также видел аналогичные результаты для генерации кода Python.

Сравнение

Как и GPT-Neo, GPT-J также бесплатен.

Основным преимуществом наличия альтернатив GPT-3 является доступность. Бесплатные генераторы языков с открытым исходным кодом делают обработку естественного языка доступной для большего числа исследователей, компаний и других организаций. Кроме того, конкуренция является здоровой для рынка. Наличие альтернатив GPT-3 от OpenAI увеличит темпы улучшения.

Разработчики языковых моделей, таких как GPT-Neo и GPT-J, проделали большую работу, сделав технологию доступной и широко доступной. Дайте нам знать, что вы думаете об этих альтернативах с открытым исходным кодом в комментариях ниже.

Подпишитесь, чтобы получить полный доступ к новостной рассылке и веб-сайту. Никогда не пропустите обновление основных тенденций в области ИИ и стартапов.

Вот немного больше о моем опыте в этом пространстве и двух книгах, которые я написал о неконтролируемом обучении и обработке естественного языка.