Jeśli masz tylko kilka minut do stracenia, oto co powinieneś wiedzieć.

-

OpenAI ma cztery wersje modelu GPT-3: Ada, Babbage, Curie i Davinci. Ada jest najmniejszym i najtańszym w użyciu modelem, ale wypada najgorzej, podczas gdy Davinci jest największym, najdroższym i najlepiej działającym z zestawu.

-

GPT-3 Davinci jest obecnie najlepiej działającym modelem na rynku. Został przeszkolony na większej ilości danych i z większą liczbą parametrów niż jego alternatywy open source, GPT-Neo i GPT-J.

-

GPT-J generalnie działa lepiej niż mniejsze wersje modeli GPT-3 OpenAI, Ada i Babbage, ale nie tak dobrze jak Davinci.

-

GPT-Neo i GPT-J są open source i bezpłatne w użyciu, a oba są dobrą alternatywą dla GPT-3 OpenAI dla użytkowników, dla których koszt jest ograniczeniem.

-

GPT ma szerokie zastosowanie w branżach takich jak rozrywka, reklama, technologia informacyjna, tworzenie oprogramowania i inne. Dostępność alternatyw GPT-3 typu open source sprawia, że ta technologia jest bardziej dostępna i przystępna cenowo dla użytkowników, co jest mile widzianym rozwiązaniem.

-

GPT-3 jest niezwykły, ale czasami spektakularnie zawodzi i ma przed sobą długą drogę, zanim poradzi sobie z zadaniami takimi jak czat otwarty.

Ten post jest sponsorowany przez Multimodal, sklep rozwojowy z siedzibą w Nowym Jorku, który koncentruje się na tworzeniu niestandardowych rozwiązań przetwarzania języka naturalnego dla zespołów produktowych przy użyciu dużych modeli językowych (LLM).

Dzięki Multimodal skrócisz czas wprowadzenia NLP na rynek w swoim produkcie. Projekty trwają zaledwie 3 miesiące od początku do końca i kosztują mniej niż 50% nowo utworzonych zespołów NLP, bez żadnych kłopotów. Skontaktuj się z nimi, aby dowiedzieć się więcej.

"Robot napisał cały ten artykuł. Czy już się boisz, człowieku?"

Taki tytuł nosił artykuł w "Guardianie" opublikowany we wrześniu 2020 r. I jak sugeruje, autor był robotem – modelem przetwarzania języka naturalnego opracowanym przez OpenAI. Ten "mikro robot" jest znany jako GPT-3. Wydany 11 czerwca 2020 r., GPT-3 stał się najczęściej omawianym generatorem językowym na świecie.

Chociaż GPT-3 był jednym z niewielu modeli tego rodzaju, kiedy zadebiutował w 2020 roku, dziś istnieje kilka alternatyw, takich jak GPT-Neo i GPT-J. Jak te alternatywy porównują się do GPT-3? Czy są lepsze, gorsze czy po prostu inne?

Zbadajmy każde z tych pytań.

Skrót GPT oznacza generatywne szkolenie wstępne. Od 2018 roku OpenAI wykorzystuje tę metodę głębokiego uczenia się do trenowania modeli językowych. Metoda ta polega na trenowaniu modelu na dużych ilościach danych w celu poprawy jego zdolności do przewidywania następnego najbardziej prawdopodobnego słowa w zdaniu. Korzystając z tego i podobnej do mózgu sieci neuronowej o nazwie Transformer, OpenAI po raz pierwszy wydała GPT w 2018 r., A następnie GPT-2 w 2019 r. i GPT-3 w 2020 r.

Każdy następca został przeszkolony na większej ilości danych i z większą liczbą parametrów i był lepiej dostrojony niż poprzedni.

GPT-3 został przeszkolony ze 175 miliardami parametrów – liczbą dziesięć razy większą niż to, z czym trenowano jego poprzednika, GPT 2. Generacje tekstu GPT-3 są oszałamiające. Może tłumaczyć z języka na inny, rozpoznawać nazwane jednostki w tekście, podsumowywać artykuły i komponować pełnometrażowe utwory. GPT-3 jest obecnie dostępny w czterech wersjach.

Ada jest najmniejsza i najtańsza, podczas gdy Davinci jest największa i najdroższa. Poniżej znajdują się szczegóły każdego modelu wraz z cenami.

Użytkownicy mogą wprowadzać proste polecenia tekstowe do GPT-3, a model daje w większości spójne wyniki. GPT-3 może być również bardzo kreatywny, pisząc wszystko, od fikcji po poezję w stylu Szekspira, Roberta Frosta, Burnsa lub innego znanego poety. Takie możliwości mają ogromną cenę – dosłownie.

GPT-3 nie jest open-source. Jest dostępny za pośrednictwem API OpenAI, ale API jest niezwykle drogie. Chociaż wysokie koszty ograniczyły powszechne przyjęcie GPT-3, naukowcy i profesjonaliści aktywnie budują prototypy i komercyjne aplikacje wykorzystujące go dzisiaj.

W ciągu ostatnich kilku lat kilka startupów opracowało własne alternatywy dla GPT-3. Opracowanie systemu takiego jak GPT-3 wymaga ogromnych inwestycji początkowych. Pomimo takich przeszkód firmy takie jak EleutherAI opracowały i wydały modele językowe open source, aby konkurować z GPT-3.

Wiele z tych modeli nie jest tak potężnych jak największe wersje GPT-3 (takie jak Curie i Davinci), ale działają równie dobrze jak prostsze modele GPT-3 (takie jak Ada i Babbage).

Oto podsumowanie popularnych alternatyw open source dla GPT-3.

GPT-Neo jest alternatywą open source dla GPT-3 i jest publicznie dostępna. Model został opracowany przez EleutherAI, zdecentralizowaną grupę badaczy i naukowców AI założoną w 2020 roku. Misją EleutherAI jest uczynienie sztucznej inteligencji bardziej dostępną poprzez opracowywanie i wydawanie modeli open source.

Ponieważ EleutherAI nie miała dostępu do zbioru danych tak obszernego i zróżnicowanego jak OpenAI, pozyskała własny 825-gigabajtowy zestaw danych o nazwie "The Pile". Ten zestaw danych zawiera dane ze źródeł akademickich, takich jak Pubmed, popularnych stron internetowych, takich jak Wikipedia i Github, a nawet napisy z filmów i programów telewizyjnych. Ponieważ EleutherAI nie dysponowała prywatnymi zasobami obliczeniowymi do opracowania swoich modeli, wykorzystała zasoby chmury obliczeniowej z chmury badawczej Google TensorFlow i chmury CoreWeave.

EleutherAI opracowało również i wypuściło drugą, większą wersję modelu o nazwie GPT-J, która ma więcej parametrów i lepiej radzi sobie z zadaniami NLP niż jego mniejszy, wcześniejszy poprzednik, GPT-Neo. GPT-J został przeszkolony na 6 miliardach parametrów i może wykonywać zadania takie jak pisanie historii, wyszukiwanie informacji, tłumaczenie i generowanie kodu.

EleutherAI opracowała również prosty interfejs użytkownika dla GPT-J. Ten interfejs pozwala użytkownikom zwiększyć poziom kreatywności modelu za pomocą parametru znanego jako "temperatura". Ponadto interfejs ma wbudowane monity dla użytkowników o zademonstrowanie możliwości modelu.

EleutherAI wykorzystała oparty na JAX (biblioteka Pythona często używana do projektów uczenia maszynowego) Transformer do opracowania GPT-J. Model został przeszkolony na tym samym zestawie danych co GPT-Neo.

Podczas gdy GPT-Neo i GPT-J są najbardziej znanymi alternatywami dla GPT-3 OpenAI, inne firmy opracowują własne warianty GPT-3. Niektóre z tych wariantów mogą wyprzedzić GPT-Neo i GPT-J pod względem popularności. Na przykład Cohere, kanadyjskie laboratorium sztucznej inteligencji, zaczęło wydawać serię modeli językowych. Inna firma o nazwie AI21 labs wypuściła Jurassic-1, model wyszkolony na 178 miliardach parametrów. Model ten rywalizuje rozmiarem największej wersji GPT-3 OpenAI, Davinci.

Podczas gdy te inne są warte monitorowania, GPT-J i GPT-Neo są obecnie najpopularniejszymi alternatywami open source dla GPT-3. Georgian, firma fintech, niedawno porównała wydajność GPT-Neo z GPT-3.

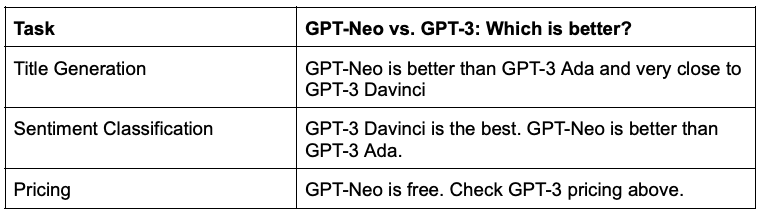

Oto kluczowy wniosek: GPT-Neo jest lepszy niż najmniejszy model OpenAI, Ada, ale nie tak dobry jak największy model OpenAI, Davinci. Biorąc to pod uwagę, GPT-Neo jest bezpłatny, podczas gdy GPT-3 Davinci jest bardzo drogi.

GPT-Neo vs. GPT-3 w zadaniu

generowania tytułu Gruziński zespół poprosił GPT-Neo i GPT-3 o wygenerowanie tytułów postów na blogu, biorąc pod uwagę następujący monit: Post opisuje proces sporządzania przemyślanych notatek ze spotkań. Autor opisuje, w jaki sposób nauczył się zapamiętywać, co dzieje się podczas długich spotkań i sugeruje praktyczne kroki, aby zintegrować nawyk robienia notatek w swoim życiu.

Oto wyniki.

GPT-Neo działa lepiej niż GPT-3 Ada, ale nie tak dobrze jak GPT-3 Davinci. Na przykład GPT-Neo generował tytuły, takie jak "Robienie notatek podczas spotkań", podczas gdy GPT-3 Davinci generował tytuły, takie jak "Jak robić notatki ze spotkań jak szef."

GPT-Neo vs. GPT-3 w zadaniu

klasyfikacji sentymentu Wyniki klasyfikacji sentymentubyły podobne: GPT-Neo przewyższył GPT-3 Adę, ale nie mógł się równać z wydajnością GPT-3 Davinci. Sprawdź bardziej szczegółowe wyniki tutaj. Porównanie

cen GPT-Neo jest open-source i darmowe.

GPT-3 Davinci, z drugiej strony, jest drogi. Aby uzyskać absolutnie najlepszą wydajność, OpenAI nadal wygrywa, ale użytkownicy z ograniczonym budżetem lub dużymi zadaniami uczenia maszynowego powinni rozważyć GPT-Neo jako alternatywę.

Kilku programistów przeprowadziło testy między GPT-J i GPT-3. Testy te obejmowały zarówno zadania zero-shot (zadania, w których nie podano oznaczonych przykładów do modelu), jak i zadania wielokrotne. Oto najważniejsze wnioski:

-

W ustawieniach zerowego strzału nie ma zauważalnej różnicy między wydajnością GPT-J i GPT-3.

-

Wydajność sprzętowa GPT-J jest porównywalna z GPT-3 Babbage.

-

GPT-J obsługuje rozmowy chatbotów lepiej niż GPT-3.

-

GPT-J jest lepszy od GPT-3 w generowaniu kodu Pythona.

-

GPT-J jest darmowy, co jest głównym punktem sprzedaży.

GPT-J działa podobnie do GPT-3 w ustawieniach

zerowego strzału Jeśli chodzi o zadania zero-shot, GPT-J działał bardzo blisko GPT-3. Aran Komatsuzaki, osoba, która przeprowadziła powyższe testy, zauważył również, że GPT-J był znacznie bardziej wydajny pod względem wydajności sprzętu niż GPT-Neo. GPT-J miał wydajność sprzętową podobną do GPT-3 Babbage. GPT-J ma lepsze możliwości chatbotaniż GPT-3 Według Maxa Woolfa, GPT-J jest lepszy w generowaniu kodu niż GPT-3

.

Należy pamiętać, że testy te były z połowy 2021 roku, a GPT-3 Davinci nie był wtedy dostępny. GPT-3 Davinci może teraz rywalizować lub przewyższać wydajność GPT-J.

GPT-J jest lepszy w generowaniu

kodu w języku Python Woolf również zaobserwował podobne wyniki dla generowania kodu w Pythonie.

cen GPT-Neo jest open-source i darmowe.

cen Podobnie jak GPT-Neo, GPT-J jest również bezpłatny.

Podstawową zaletą posiadania alternatyw GPT-3 jest przystępność cenowa. Darmowe generatory języka open source sprawiają, że przetwarzanie języka naturalnego jest dostępne dla większej liczby badaczy, firm i innych organizacji. Również konkurencja jest zdrowa dla rynku. Posiadanie alternatyw dla GPT-3 OpenAI zwiększy tempo poprawy.

Twórcy modeli językowych, takich jak GPT-Neo i GPT-J, wykonali świetną robotę, dzięki czemu technologia jest przystępna cenowo i szeroko dostępna. Daj nam znać, co myślisz o tych alternatywach open source w komentarzach poniżej.

Zapisz się, aby uzyskać pełny dostęp do newslettera i strony internetowej. Nigdy nie przegap aktualnych informacji na temat głównych trendów w sztucznej inteligencji i startupach.

Oto trochę więcej o moich doświadczeniach w tej przestrzeni i dwóch książkach, które napisałem na temat uczenia się bez nadzoru i przetwarzania języka naturalnego.