Якщо у вас є лише кілька хвилин, щоб заощадити, ось що вам слід знати.

-

OpenAI має чотири версії моделей GPT-3: Ada, Babbage, Curie і Davinci. Ada є найменшою та найдешевшою у використанні моделлю, але працює найгірше, тоді як Davinci є найбільшою, найдорожчою та найефективнішою з набору.

-

GPT-3 Davinci є найефективнішою моделлю на сучасному ринку. Він був навчений на більшій кількості даних і з більшою кількістю параметрів, ніж його альтернативи з відкритим кодом, GPT-Neo і GPT-J.

-

GPT-J, як правило, працює краще, ніж менші версії моделей GPT-3 від OpenAI, Ada і Babbage, але не зовсім так добре, як Davinci.

-

GPT-Neo та GPT-J є відкритим вихідним кодом та безкоштовними у використанні, і обидва є хорошими альтернативами GPT-3 OpenAI для користувачів, для яких вартість є обмеженням.

-

GPT має широке застосування в таких галузях, як розваги, реклама, інформаційні технології, розробка програмного забезпечення тощо. Наявність альтернатив GPT-3 з відкритим вихідним кодом робить цю технологію більш доступною та доступною для користувачів, що є бажаною розробкою.

-

GPT-3 чудовий, але іноді вражаюче виходить з ладу і має пройти довгий шлях, перш ніж він зможе впоратися з такими завданнями, як відкритий чат.

Ця публікація спонсорується Multimodal, магазином розробників з Нью-Йорка, який зосереджується на створенні індивідуальних рішень для обробки природною мовою для команд продуктів з використанням великих мовних моделей (LLM).

З Multimodal ви скоротите свій час виходу на ринок для впровадження НЛП у свій продукт. Проекти займають всього 3 місяці від початку до кінця і коштують менше 50% новостворених команд НЛП, без будь-яких клопотів. Зв'яжіться з ними, щоб дізнатися більше.

"Робот написав всю цю статтю. Ти ще боїшся, людино?"

Такою була назва публікації Guardian, опублікованої у вересні 2020 року. І, як випливає з припущення, автором був робот — модель обробки природної мови, розроблена OpenAI. Цей «мікроробот» відомий як GPT-3. Випущений 11 червня 2020 року, GPT-3 став найбільш обговорюваним у світі генератором мов.

Хоча GPT-3 був однією з єдиних моделей у своєму роді, коли він дебютував у 2020 році, сьогодні існує кілька альтернатив, таких як GPT-Neo та GPT-J. Як ці альтернативи порівнюються з GPT-3? Вони кращі чи гірші чи просто різні?

Давайте розглянемо кожне з цих питань.

Абревіатура GPT розшифровується як генеративна передпідготовка. З 2018 року OpenAI використовує цей метод глибокого навчання для навчання мовних моделей. Цей метод передбачає навчання моделі на великих обсягах даних з метою поліпшення її здатності прогнозувати наступне найбільш ймовірне слово в реченні. Використовуючи цю та мозкову нейронну мережу під назвою Transformer, OpenAI вперше випустила GPT у 2018 році, а потім GPT-2 у 2019 році та GPT-3 у 2020 році.

Кожен наступник був навчений більшій кількості даних і з більшою кількістю параметрів і був краще налаштований, ніж останній.

GPT-3 був навчений з параметрами 175 мільярдів — число в десять разів більше, ніж було навчено його попередника, GPT 2. Текстові покоління GPT-3 досить приголомшливі. Він може перекладати з мови на іншу, розпізнавати іменовані сутності в тексті, узагальнювати статті та складати повнометражні твори. В даний час GPT-3 поставляється в чотирьох версіях.

Ада - найменша і найдешевша, в той час як Davinci - найбільша і дорога. Нижче наведено деталі кожної моделі разом із цінами.

Користувачі можуть вводити прості текстові команди в GPT-3, і модель видає в основному узгоджені результати. GPT-3 теж може бути досить креативним, пишучи все, від художньої літератури до поезії в стилі Шекспіра, Роберта Фроста, Бернса або будь-якого іншого відомого поета. Такі можливості мають величезну ціну — буквально.

GPT-3 не є відкритим вихідним кодом. Він доступний через API OpenAI, але API надзвичайно дорогий. Хоча високі витрати обмежили основне впровадження GPT-3, дослідники та професіонали активно створюють прототипи та комерційні програми, використовуючи його сьогодні.

За останні кілька років кілька стартапів розробили власні альтернативи GPT-3. Розробка такої системи, як GPT-3, вимагає величезних попередніх інвестицій. Незважаючи на такі перешкоди, такі компанії, як EleutherAI, розробили та випустили мовні моделі з відкритим кодом, щоб конкурувати з GPT-3.

Багато з цих моделей не такі потужні, як найбільші версії GPT-3 (такі як Curie і Davinci), але вони працюють так само добре, як і більш прості моделі GPT-3 (такі як Ada і Babbage).

Ось короткий зміст популярних альтернатив GPT-3 з відкритим кодом.

GPT-Neo є альтернативою GPT-3 з відкритим вихідним кодом і є загальнодоступним. Модель була розроблена EleutherAI, децентралізованою групою дослідників і вчених ШІ, заснованою в 2020 році. Місія EleutherAI полягає в тому, щоб зробити ШІ більш доступним, розробляючи та випускаючи моделі з відкритим кодом.

Оскільки EleutherAI не мав доступу до набору даних, такого великого та різноманітного, як у OpenAI, він отримав власний набір даних на 825 гігабайт під назвою «The Pile». Цей набір даних включає дані з академічних джерел, таких як Pubmed, поширених веб-сайтів, таких як Вікіпедія та Github, і навіть субтитри з фільмів та телешоу. Оскільки він не мав приватних обчислювальних ресурсів для розробки своїх моделей, EleutherAI використовував ресурси хмарних обчислень з хмари TensorFlow Research від Google і хмари CoreWeave.

EleutherAI також розробила і випустила другу, більшу версію моделі під назвою GPT-J, яка має більше параметрів і краще справляється з завданнями НЛП, ніж її менший, більш ранній попередник, GPT-Neo. GPT-J пройшов навчання за 6 мільярдами параметрів і може виконувати такі завдання, як написання історій, інформаційний пошук, переклад і генерація коду.

EleutherAI також розробив простий користувальницький інтерфейс для GPT-J. Цей інтерфейс дозволяє користувачам підвищити рівень креативності моделі, використовуючи параметр, відомий як "температура". Крім того, в інтерфейсі є вбудовані підказки для користувачів для демонстрації можливостей моделі.

EleutherAI використовував JAX-бібліотеку (бібліотека Python, яка часто використовується для проектів машинного навчання) Transformer для розробки GPT-J. Модель була навчена на тому ж наборі даних, що і GPT-Neo.

У той час як GPT-Neo і GPT-J є найвідомішими альтернативами GPT-3 від OpenAI, інші компанії розробляють власні варіанти GPT-3. Деякі з цих варіантів можуть обігнати за популярністю GPT-Neo і GPT-J. Наприклад, канадська лабораторія штучного інтелекту Cohere почала випускати серію мовних моделей. Інша компанія під назвою AI21 labs випустила Jurassic-1, модель, навчену на 178 мільярдах параметрів. Ця модель конкурує за розмірами з найбільшою версією GPT-3 від OpenAI, Davinci.

Хоча ці інші варто контролювати, GPT-J та GPT-Neo є найпопулярнішими альтернативами GPT-3 з відкритим кодом сьогодні. Грузинська, фінтех-компанія, нещодавно порівняла показники GPT-Neo з GPT-3.

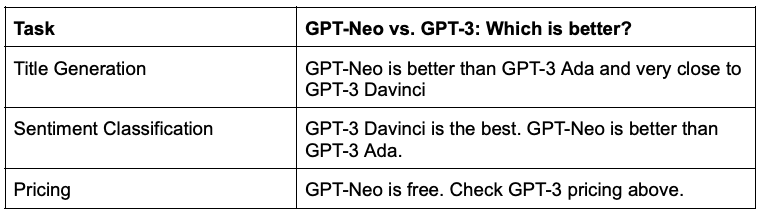

Ось ключовий висновок: GPT-Neo краще, ніж найменша модель OpenAI, Ada, але не така хороша, як найбільша модель OpenAI, Давінчі. При цьому GPT-Neo безкоштовний, тоді як GPT-3 Davinci дуже дорогий.

GPT-Neo проти GPT-3 на завданні

генерації заголовка Грузинська команда попросила GPT-Neo та GPT-3 створити заголовки дописів у блозі з такою підказкою: У дописі описується процес вдумливих нотаток про зустріч. Автор висвітлює, як він навчився пам'ятати про те, що відбувається під час тривалих зустрічей, і пропонує дієві кроки для інтеграції звички робити нотатки у ваше життя.

Ось результати.

GPT-Neo працює краще, ніж GPT-3 Ada, але не зовсім так добре, як GPT-3 Davinci. Наприклад, GPT-Neo генерував назви, такі як "Конспектування під час зустрічей", тоді як GPT-3 Davinci генерував такі назви, як "Як робити нотатки з зустрічей, як бос."

GPT-Neo vs. GPT-3 на Завдання

класифікації настроїв Результати класифікації настроїв були схожими: GPT-Neo перевершив GPT-3 Ada, але не міг зрівнятися з показниками GPT-3Davinci. Перегляньте більш детальні результати тут. Порівняння

цін GPT-Neo є відкритим і безкоштовним.

ГПТ-3 Давінчі ж коштує дорого. Для абсолютної найкращої продуктивності OpenAI все ще виграє, але користувачам з обмеженими бюджетами або великими завданнями машинного навчання слід розглядати GPT-Neo як альтернативу.

Кілька розробників провели тести між GPT-J і GPT-3. Ці тести включали як завдання з нульовим пострілом (завдання, де модель не надає маркованих прикладів), так і завдання з багаторазовим пострілом. Ось ключові висновки:

-

В налаштуваннях нульового пострілу немає помітної різниці між продуктивністю GPT-J і GPT-3.

-

Апаратна продуктивність GPT-J нарівні з GPT-3 Babbage.

-

GPT-J краще справляється з розмовами чат-ботів, ніж GPT-3.

-

GPT-J перевершує GPT-3 при генерації коду Python.

-

GPT-J безкоштовний, основна точка продажу.

GPT-J працює аналогічно GPT-3 в налаштуваннях

нульового пострілу Коли справа доходить до завдань з нульовим пострілом, GPT-J виконувався дуже близько до GPT-3. Аран Комацузакі, людина, яка виконувала тести вище, також помітив, що GPT-J був набагато ефективнішим у продуктивності обладнання, ніж GPT-Neo. GPT-J мав апаратну продуктивність, подібну до GPT-3 Babbage. GPT-J має кращі здібності чат-бота, ніж GPT-3 За словами Макса Вулфа, GPT-J краще генерує код, ніж GPT-3

.

Відзначимо, що ці тести були з середини 2021 року, а GPT-3 Davinci тоді був недоступний. GPT-3 Davinci тепер може конкурувати або перевищувати продуктивність GPT-J.

GPT-J кращий у генерації

коду Python Вулф також побачив подібні результати для генерації коду Python.

цін GPT-Neo є відкритим і безкоштовним.

цін Так само, як і GPT-Neo, GPT-J також безкоштовний.

Основною перевагою наявності альтернатив GPT-3 є доступність. Безкоштовні генератори мов з відкритим кодом роблять обробку природної мови доступною для більшої кількості дослідників, компаній та інших організацій. Також конкуренція здорова для ринку. Наявність альтернатив GPT-3 від OpenAI збільшить темпи вдосконалення.

Розробники мовних моделей, таких як GPT-Neo і GPT-J, зробили велику роботу, зробивши технологію доступною і широко доступною. Повідомте нам, що ви думаєте про ці альтернативи з відкритим кодом, у коментарях нижче.

Підпишіться, щоб отримати повний доступ до розсилки та веб-сайту. Ніколи не пропускайте оновлення про основні тенденції в AI та стартапах.

Ось трохи більше про мій досвід роботи в цьому просторі та дві книги, які я написав про навчання без нагляду та обробку природної мови.