Пакет Ollama Laravel обеспечивает бесшовную интеграцию с API Ollama:

Ollama-Laravel — это пакет Laravel, который обеспечивает бесшовную интеграцию с API Ollama. Он включает в себя функции для управления моделями, генерации подсказок, настройки формата и многого другого. Этот пакет идеально подходит для разработчиков, которые хотят использовать возможности Ollama API в своих приложениях Laravel.

Получите доступ к мощной Meta LLaMA: базовой языковой модели с 65 миллиардами параметров локально и взаимодействуйте с ней с помощью Laravel. Вы можете получить доступ к различным моделям, таким как llama2, openchat, starcoder (модель генерации кода, обученная на 80+ языках), sqlcoder и другим моделям, обученным медицине, психологии и многим другим. Это отличный способ для разработчиков получить опыт работы с большими моделями изучения языков локально!

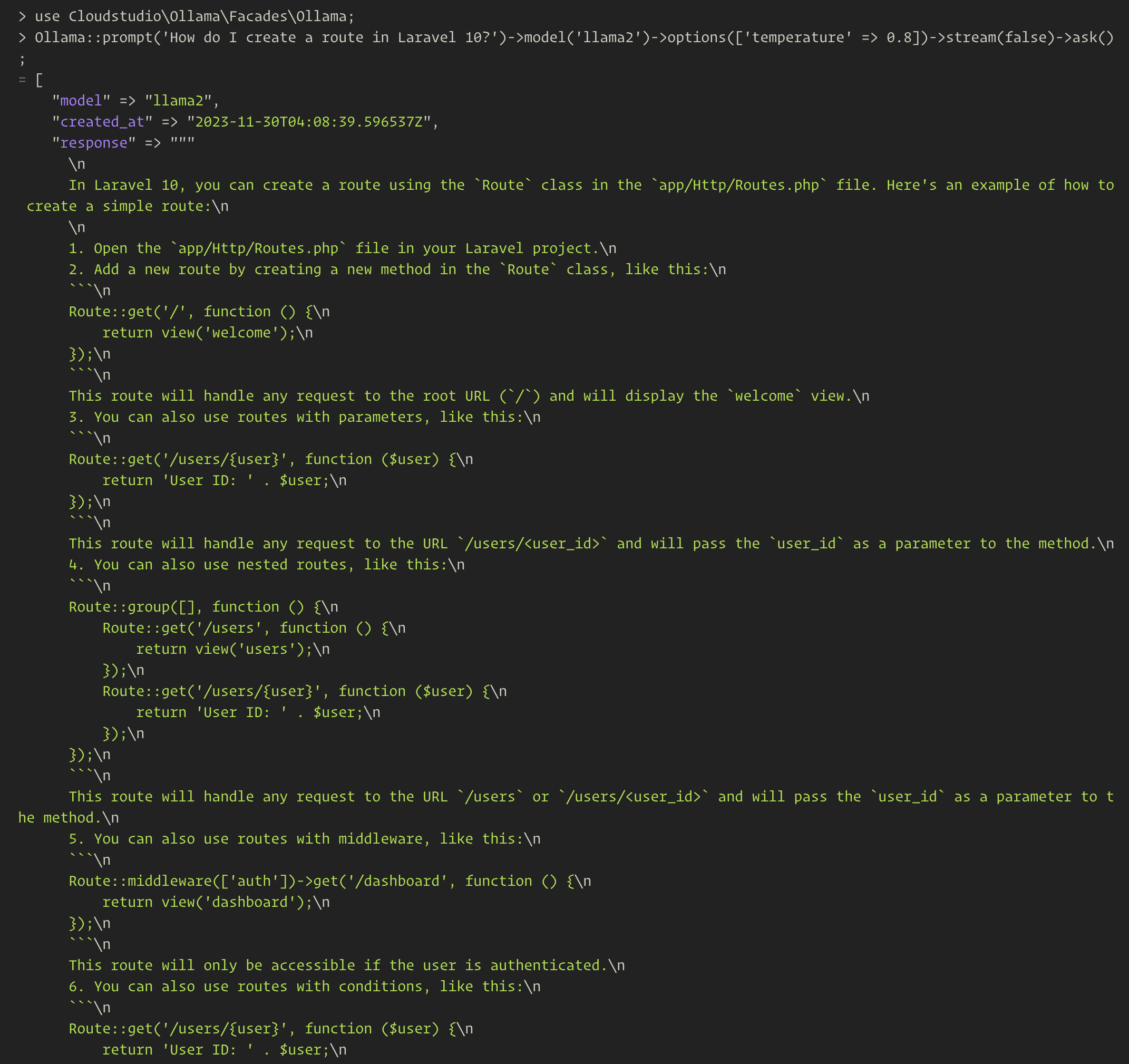

После того, как вы установите этот пакет в Laravel, вы можете использовать фасад пакета Ollama для взаимодействия с выбранной вами моделью. Вот пример типичного обмена с языковой моделью:

use Cloudstudio\Ollama\Facades\Ollama;

$response = Ollama::prompt('How do I create a route in Laravel 10?')

->model('llama2')

->options(['temperature' => 0.8])

->stream(false)

->ask();

Вот пример ответа из оболочки Tinker, которую я попробовал с ней:

Как видите, он не дал мне точного ответа, но здорово, что я могу экспериментировать с языковыми моделями локально на своей машине 💪

В настоящее время Ollama поддерживается в macOS и Linux, а скоро появится и Windows. Вам нужно будет скачать Ollama и установить его, чтобы использовать этот пакет. В зависимости от модели, которую вы хотите запустить, загрузка и установка может занять некоторое время. У вас также есть возможность создать учетную запись и поделиться своими моделями.

Вы можете узнать больше об использовании Ollama Laravel, получить полные инструкции по установке и просмотреть исходный код на GitHub.