Пакет Ollama Laravel забезпечує безперебійну інтеграцію з Ollama API:

Ollama-Laravel — це пакет Laravel, який забезпечує безперебійну інтеграцію з Ollama API. Він включає функції для керування моделлю, генерації підказок, налаштування формату тощо. Цей пакет ідеально підходить для розробників, які хочуть використовувати потужність Ollama API у своїх програмах Laravel.

Отримайте доступ до потужної Meta LLaMA: базової мовної моделі з 65 мільярдами параметрів локально та взаємодійте з нею за допомогою Laravel. Ви можете отримати доступ до різних моделей, таких як llama2, openchat, starcoder (модель генерації коду, навчена на 80+ мовах), sqlcoder та інші моделі, навчені медицині, психології тощо. Це чудовий спосіб для розробників отримати досвід роботи з великими моделями вивчення мови на місцевому рівні!

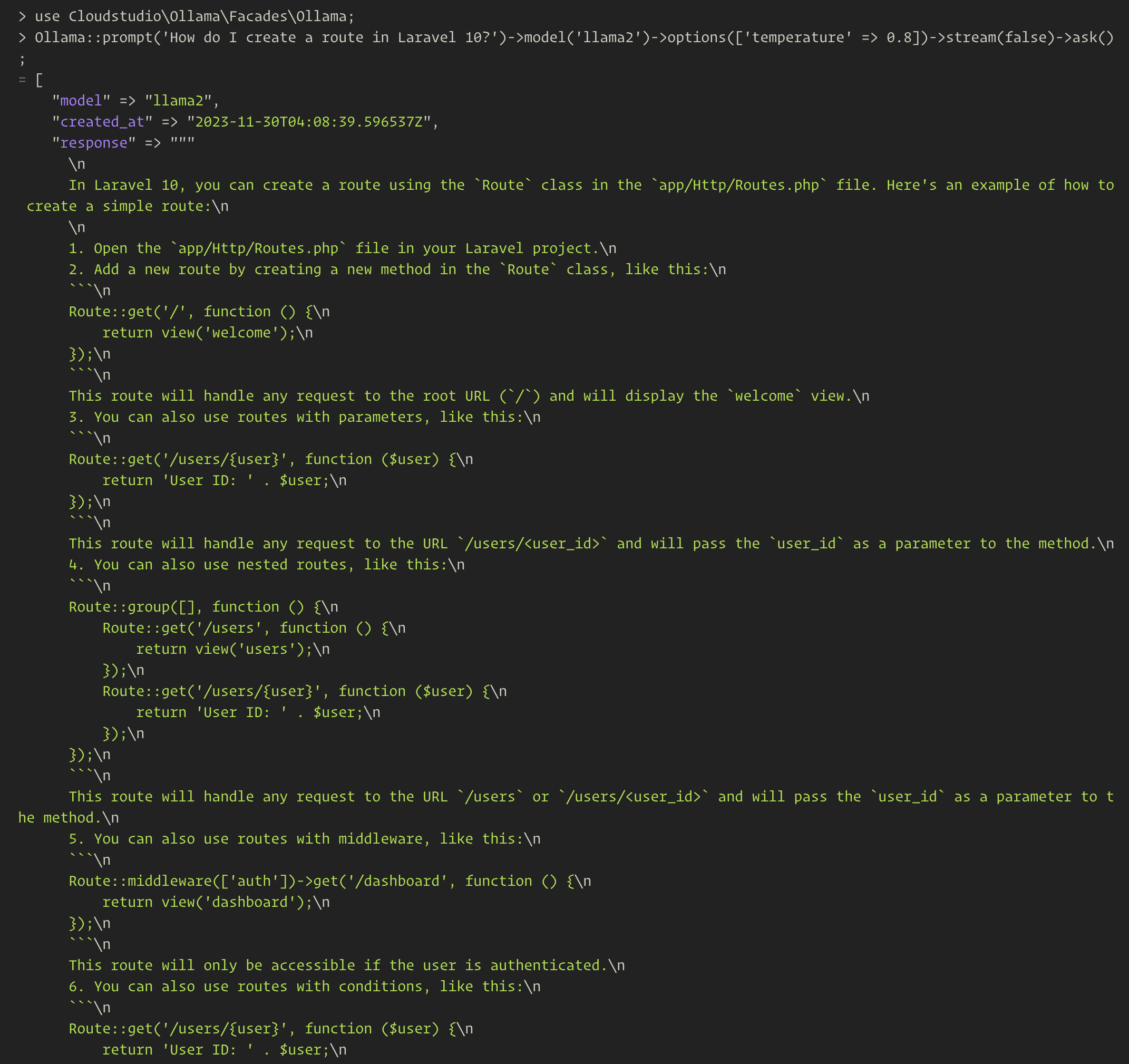

Після того, як ви встановите цей пакет у Laravel, ви зможете використовувати фасад пакета Ollama для взаємодії з обраною вами моделлю. Ось приклад типового обміну з мовною моделлю:

use Cloudstudio\Ollama\Facades\Ollama;

$response = Ollama::prompt('How do I create a route in Laravel 10?')

->model('llama2')

->options(['temperature' => 0.8])

->stream(false)

->ask();

Ось приклад відповіді від оболонки Tinker, яку я спробував з нею:

Як бачите, це не дало мені точної відповіді, але добре, що я можу експериментувати з мовними моделями локально на власному комп'ютері 💪

Наразі Ollama підтримується на macOS і Linux, а Windows з'явиться незабаром. Вам потрібно буде завантажити Ollama та встановити його, щоб використовувати цей пакунок. Залежно від моделі, яку ви хочете запустити, завантаження та інсталяція може зайняти деякий час. У вас також є можливість створити обліковий запис і ділитися власними моделями.

Ви можете дізнатися більше про використання Ollama Laravel, отримати повну інструкцію зі встановлення та переглянути вихідний код на GitHub.