Pakiet Ollama Laravel zapewnia bezproblemową integrację z interfejsem API Ollama:

Ollama-Laravel to pakiet Laravel, który zapewnia bezproblemową integrację z interfejsem API Ollama. Zawiera funkcje zarządzania modelami, generowania monitów, ustawiania formatu i nie tylko. Ten pakiet jest idealny dla programistów, którzy chcą wykorzystać moc Ollama API w swoich aplikacjach Laravel.

Uzyskaj dostęp do potężnego Meta LLaMA: podstawowego modelu językowego zawierającego 65 miliardów parametrów lokalnie i połącz się z nim za pomocą Laravel. Możesz uzyskać dostęp do różnych modeli , takich jak llama2, openchat, starcoder (model generowania kodu wyszkolony na 80+ językach), sqlcoder i inne modele przeszkolone w medycynie, psychologii i innych. Jest to doskonały sposób dla programistów, aby zdobyć doświadczenie z dużymi modelami nauki języków lokalnie!

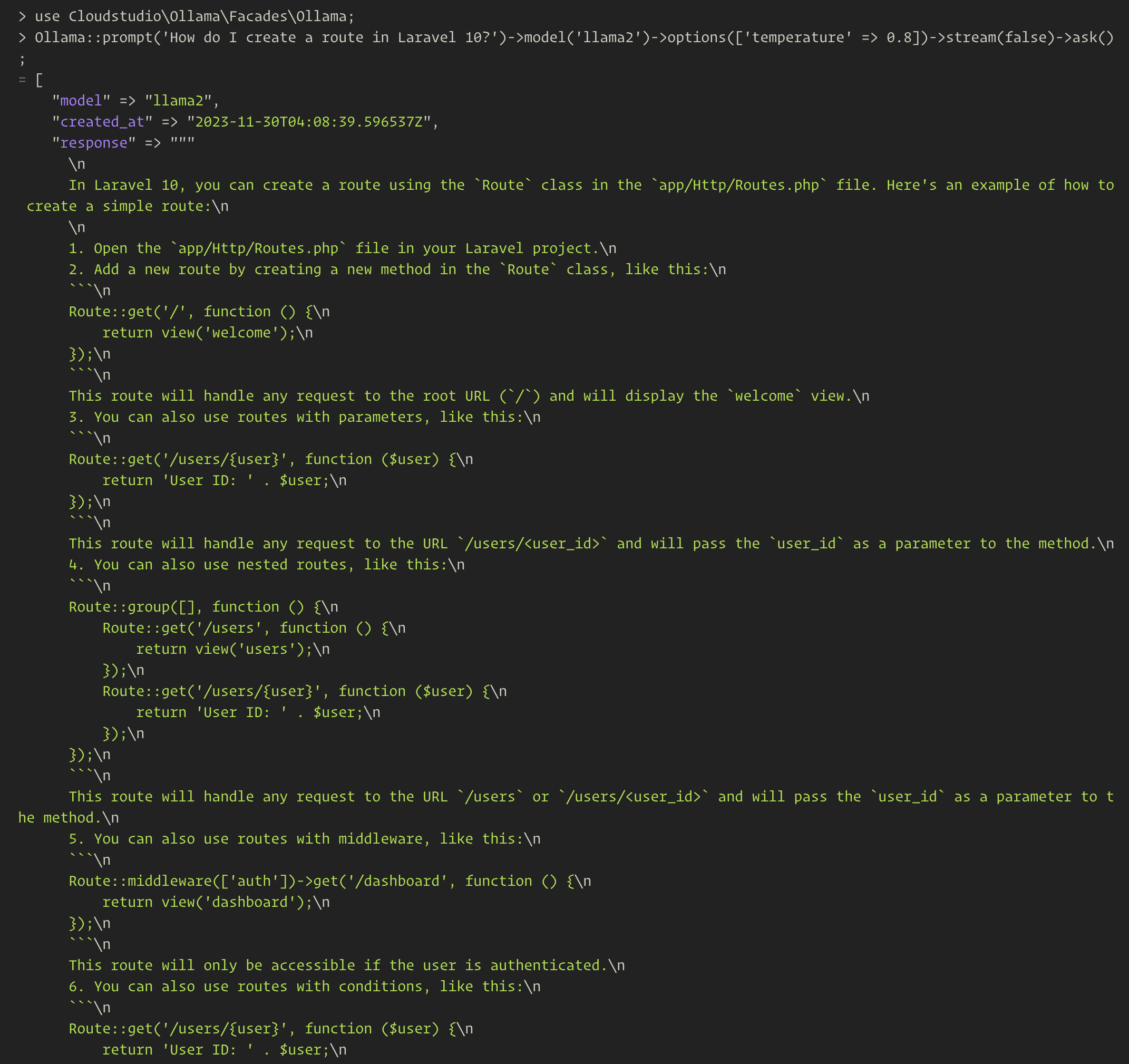

Po zainstalowaniu tego pakietu w Laravel, możesz użyć fasady Ollama pakietu do interakcji z wybranym modelem. Oto przykład typowej wymiany z modelem językowym:

use Cloudstudio\Ollama\Facades\Ollama;

$response = Ollama::prompt('How do I create a route in Laravel 10?')

->model('llama2')

->options(['temperature' => 0.8])

->stream(false)

->ask();

Oto przykładowa odpowiedź z powłoki majsterkowicza, którą wypróbowałem z nią:

Jak widać, nie dało mi to dokładnej odpowiedzi, ale fajnie, że mogę eksperymentować z modelami językowymi lokalnie na mojej własnej maszynie 💪

Obecnie Ollama jest obsługiwana w systemach macOS i Linux, a wkrótce pojawi się system Windows. Aby korzystać z tego pakietu, musisz pobrać Ollamę i zainstalować ją. W zależności od modelu, który chcesz uruchomić, pobieranie i instalowanie może zająć trochę czasu. Masz również możliwość utworzenia konta i udostępniania własnych modeli.

Możesz dowiedzieć się więcej o korzystaniu z Ollama Laravel, uzyskać pełne instrukcje instalacji i wyświetlić kod źródłowy w usłudze GitHub.